De ontwikkeling van AI heeft een lange en fascinerende geschiedenis die teruggaat tot de jaren 50 van de vorige eeuw. In de jaren 90 verschoof de focus naar machine learning. In 2000 zorgde de verbeteringen in rekenkracht ervoor, dat er een subveld van machine learning geïnspireerd werd door de structuur en functies van het menselijk brein. En vandaag de dag ervaren we dagelijks wel iets van AI., is Siri, Alexa en tools als ChatGPT niet weg te denken.

En nee. Het zal hier echt niet bij blijven. De vraag is en blijft uiteraard: Waar gaat dit naar toe? Worden die films met AI Robots die lijken op mensen en de wereld overnemen dadelijk realiteit? Gaat AI ‘ons’ werk overnemen? Denk hierbij een Pools bedrijf een AI-robot tot mededirecteur benoemde.

Gelukkig houden wij ons niet alleen bezig met de vragen. Over de hele wereld wordt actief nagedacht over regelgeving om de groei en implementatie van AI te sturen. Waarbij het vooral gaat om ethische, veiligheids- en privacy vraagstukken. Ook binnen onze eigen Europese Unie zijn ze hiermee bezig in de vorm van een AI Act.

Maat het één ding is zeker: AI kan ons als Moodle beheerders, docenten, content bouwers en lerende ondersteunen.

LT&C en AI

Ja ook bij LT&C experimenteren we met tools zoals ChatGPT. Denk hierbij aan het maken van HTML of CSS codes, database query’s of het fixen van een code issue. Maar AI helpt ons ook bij praktische zaken zoals:

- Het controleren van deze blog.

- Social media tekst schrijven.

- Het vinden van de ‘juiste toon’ bij een supportvraag.

Ik schrijf experimenteren. Wat ik hiermee bedoel is dat we ChatGPT niet helemaal de vrije hand geven. Elke in -en output wordt overwogen, gecontroleerd en geverifieerd. Want we blijven de experts op ons eigen vakgebied en gebruiken AI ter ondersteuning. Zo is een deel van deze blog geschreven dankzij de input van ChatGPT.

AI en Moodle LMS

Tijdens de keynote lezing Lifelong Intelligence, voorspelde Martin Dougiamas, oprichter van Moodle Pty Ltd over AI: ‘Generatieve AI zal een grotere impact hebben op onze wereld, dan de dag dat het internet werd uitgevonden’.

Begin jaren 90 deed hij eenzelfde uitspraak over de opkomst van het internet, en hoe dit een impact zal krijgen op onze wereld en daaruit volgende veranderingen hoe wij zouden gaan doceren en leren. En in de community vonden wij het dan ook helemaal niet raar, toen hij aankondigde dat hij het stokje als CEO overdroeg heeft aan Scott Anderberg en nu Head of Research is met focus op de impact van AI op de wereld van Edtech.

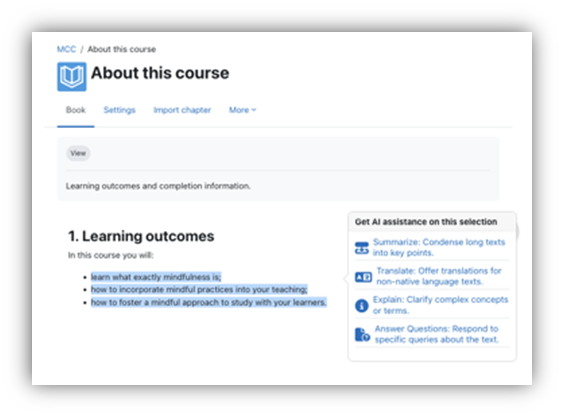

Martin is uiteraard niet de enige die bezig is met de mogelijkheden die AI de Educatie sector kan bieden, zien we ook terug in de Moodle Plugin database. Op de MoodleMoot Global kwam de kracht van AI in Moodle LMS in vele presentaties naar voren. En in de database zien we dan ook modules zoals:

- Vragen en afbeeldingen generen met AI

- OpenAI Chat block

- Copyleaks Plagiarism and AI Content Detector.

Dit is niet alles, want dit jaar nog zullen we in de Moodle Core een AI functionaliteit kunnen verwachten.

AI en het onderwijs

Zoals ik al schreef, AI is niet meer weg te denken uit onze wereld. Er is ook géén enkel twijfel meer dat AI ook in het onderwijs een meerwaarde kan hebben. Denk hierbij aan:

- Het persoonlijker maken van leerervaringen,

- (Semi)automatisch feedback.

- Sneller identificeren van leerproblemen.

Maar als AI echt goed wil inzetten, is het wel belangrijk dat je weet hoe de technologie werkt. Nu zie ik overal korte sessies verschijnen met allerlei tips over prompt gebruik en hoe je snel content en afbeeldingen kan maken. En hoewel dit belangrijk is, is het ook belangrijk dat je stil staat bij de risico’s en de ethische aandachtspunten.

AI en de kritische vraag: moeten we dit wel willen?

‘Uhhu duhh ja echt wel!’ Is het veel gehoorde antwoord op die vraag. Weet je wel niet wat je er allemaal mee kan?! In mijn omgeving voelt het dan ook alsof iedereen ‘besmet’ is geraakt door de enthousiasme rondom AI.

Als ik vervolgens de vragen stel: ‘Maar moet je vragen door een AI tool moeten laten maken? Welke bron wordt gebruikt? En hoe weet je dat deze bron de juiste is?’ Dan krijg ik vaak een blik van: daar heb je haar weer. Waarom kun jij niet net zoals ik de mogelijkheden zien?

Laten we voorop stellen dat ik de mogelijkheden echt wel zie. En dat dit artikel niet bedoeld is om jouw enthousiasme voor AI af te remmen. In tegenstelling, ik raad je zelfs aan om te gaan experimenteren en je creativiteit de vrije hand te geven. Dat doe ik namelijk ook. Niet alleen als Moodle Beheerder, maar ook vanuit ondernemerschap onderzoek ik hoe AI een ondersteunde rol kan hebben.

Maar ik beschouw mezelf als een slechte adviseur, ondernemer en beheerder, als ik niet zou durven de kritische vragen te stellen rondom de ethische en privacy kant van AI. Deze aspecten negeren of alleen in de handen van onze wetgevers laten, zou mijns inziens naïef zijn. Laten we er het meest bekende voorbeeld erbij pakken: AI Hallucinaties.

AI die antwoorden verzint – Hallucineren

AI-hallucinaties verwijzen naar situaties waarin een kunstmatige intelligentie (AI), zoals een taalmodel of beeldgeneratiemodel, onjuiste, gefabriceerde of geheel onverwachte uitkomsten produceert die niet overeenkomen met de werkelijkheid of de verwachte output. Laten we eens een aantal voorbeelden bekijken:

- Onjuiste feiten of gegevens: Een AI die teksten genereert, kan soms overtuigend klinkende, maar volledig onjuiste feiten of statistieken verzinnen. Bijvoorbeeld, het kan beweren dat een bepaalde historische figuur een gebeurtenis heeft meegemaakt die nooit heeft plaatsgevonden of dat een stad in een verkeerd land ligt.

- Verzonnen citaten of referenties: AI kan citaten toewijzen aan beroemdheden, wetenschappers of historische figuren die zij nooit echt hebben gezegd of geschreven. Dit kan variëren van volledig verzonnen uitspraken tot onjuist toegeschreven bestaande citaten.

- Niet-bestaande inhoud in beeldgeneratie: Bij beeldgenererende AI kunnen hallucinaties leiden tot de creatie van beelden met niet-bestaande, vaak bizarre of onmogelijke elementen. Bijvoorbeeld, een AI kan een afbeelding creëren van een dier met eigenschappen van meerdere verschillende soorten, zoals een vogel met de poten van een olifant.

- Samensmelting van contexten of personages: In complexe scenario’s kan AI personages, locaties of tijdsperiodes op onlogische wijze combineren. Bijvoorbeeld, in een door AI gegenereerd verhaal kan een historisch figuur verschijnen in een moderne setting zonder logische verklaring, of kan het plot elementen uit verschillende culturen of tijdperken vermengen die historisch niet overeenkomen.

Deze hallucinaties zijn vaak het resultaat van de onderliggende trainingsdata en de beperkingen van het model in het begrijpen van context, causaliteit, en de complexiteit van de echte wereld. Het identificeren en corrigeren van dergelijke hallucinaties is een actief onderzoeksgebied in AI-ontwikkeling. In juni 2023 schreef ITDaily , dat om dit dit te voorkomen, OpenAI wordt verbeterd en er nieuwe trainingsmethodes ontwikkelt worden. De vraag is of dat eigenlijk wel kan. In een interview met Business Insider, reageerde Sam Altman, CEO van OpenAI op dit onderwerp met de uitspraak: dat het een creatieve manier om tot nieuwe ideeën te komen noemde.

Mijn visie

Uiteraard is er geen goed of fout, maar als we AI willen gaan inzetten om leerlingen automatisch van feedback te voorzien. Dan weet ik niet of ik als onderwijzer of lerende blij ga zijn als deze feedback op een creatieve manier tot stand is gekomen om tot nieuwe ideeën te laten komen, zonder dat een feitencheck op heeft plaatsgevonden.

Mijn man zou zeggen dat het de control freak in mij is. En ja deels zal hij gelijk hebben. Maar toch spreekt hier ook de nodige IT ervaring met zich mee. Als ik kijk naar AI, dan zie ik het als een software die we kunnen gebruiken om ons werk of leven te ondersteunen. Als het software is, dan is het basis ontwikkelt door andere – software ontwikkelaar. Dat het door mensen ontwikkelt heeft geeft ook voordelen met zich mee, maar legt ook een grote verantwoordelijkheid bij hun én de gebruikers van de software.

Een irritatie die ik wellicht wel meerdere keren per maand hoor is de irritatie bij gebruikers wanneer volgens hun de computers en/of software fouten maakt en daardoor dingen mis gaan. Dat men dit zo ervaart vind ik niet raar, want voor hun is dit ook wat er gebeurd. Maar praktijk is dat een computers of software uit zichzelf géén fouten maakt.

Fouten in systemen zijn vaak het resultaat van een niet verwachte input. Maar het kan ook zeker een ‘code bug’ zijn, waardoor je bijvoorbeeld een ChatGPT urenlang nonsens deelde door een bug.

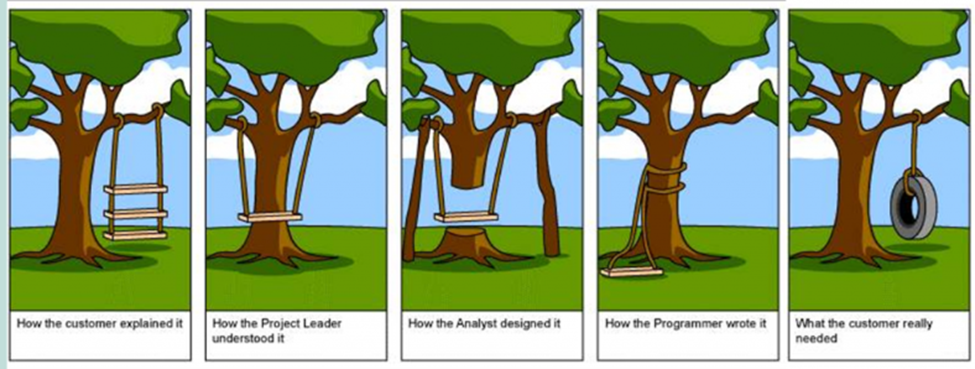

Persoonlijk praat ik liever niet over ‘fouten in software’. Een ontwikkelaar is tenslotte ook een mens, en mensen maken nu eenmalig fouten? En wanneer het gaat om een niet verwachte input dan kun je niet praten over een fout van een ontwikkelaar. Maar dan hebben we het over een mismatch in de verwachtingen tussen gebruiker en ontwikkelaar. Wat mij doet denken aan een afbeelding die binnen de ontwikkel community zeer bekend is.

AI zijn toch zelflerende machines…

Jazeker, maar wist je dat hier verschillende vormen in zijn. En dat bij welke vorm ook er altijd een menselijke input nodig is? Dit kan jij als gebruiker zijn maar ook een programmeur of leverancier.

Als je vanuit AI kijkt, kan een ‘fout’ dus ook ontstaan door de manier waarop jij jouw prompt formuleert. Want deze prompt is een deel van de input die output tot stand brengt. Een ander deel van de input is de bron , o.a. het trainingsmodel, die wordt gebruikt.

Als jij een prompt ingeeft, heb je dan weleens nagedacht over: welke bron wordt er geraadpleegd? En hoe betrouwbaar is deze?

Een antwoord dat ik kreeg van iemand was: het internet. Waarop ik weer vraag: deze staat vandaag de dag ook vol van misinformatie. Hoe weet jouw AI welke informatie nu klopt of niet. En laten we dan één stap verder gaan: Kan AI een rol spelen in het verspreidde van misinformatie. Facebook Eigenaar Meta Platforms denkt in ieder geval wel, want zij hebben een team gaat opgezet om desinformatie en AI misbruik aan te pakken met zicht op de Europese Verkiezingen.

Samengevat

Technologische ontwikkelingen, waar AI onder valt, zijn gewoonweg niet te vermijden. En kan een verrijking zijn in ons leven omdat AI ons kan ondersteunen en ontzorgen in ons dagelijks werk en leven.

Maar net zoals bij andere technologische zaken, vraagt het dat wij als mensen en organisatie (zelf) blijven nadenken over de risico’s. En is het maar goed dat steeds meer software leveranciers op hun visie op AI op een transparante manier delen met hun gebruikers. De visie van Moodle Pty Ltd lees je op hun website: Moodle and Our AI Principles.

Ook Europees niveau is er informatie te vinden die je kan gebruiken om jezelf in te lezen. Zo publiceerde de High-Level Expert Group on Artificial Intelligence opgezet door de Europese Commissie, richtlijnen focussen op het waarborgen van betrouwbare AI. En zijn er ook richtlijnen over het gebruik van AI en data in het onderwijs.

De meest belangrijke boodschap die ik heb is: ga lekker experimenteren, onderzoek de mogelijkheden en laat je inspireren door anderen. Maar blijft a.u.b. met twee benen op de grond, schakel menselijke factoren niet uit en praat in je organisatie ook samen over een visie en beleid rondom het toepassen van AI.